Os principais usuários e os benchmarks padrão do setor concordam: as GPUs NVIDIA H100 Tensor Core oferecem o melhor desempenho de IA, especialmente nos grandes modelos de linguagem (LLMs) que alimentam a IA generativa.

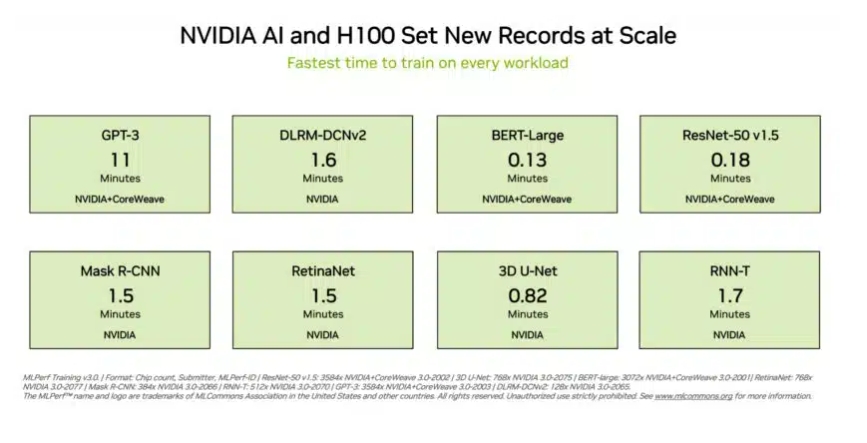

As GPUs H100 estabeleceram novos recordes em todos os oito testes nos últimos benchmarks de treinamento MLPerf lançados, destacando-se em um novo teste MLPerf para IA generativa. Essa excelência é fornecida por acelerador e em escala em servidores massivos.

Por exemplo, em um cluster comercialmente disponível de 3.584 GPUs H100 co-desenvolvido pela startup Inflection AI e operados pela CoreWeave, um provedor de serviços em nuvem especializado em cargas de trabalho aceleradas por GPU, o sistema concluiu o enorme benchmark de treinamento baseado em GPT-3 em menos de onze minutos.

“Nossos clientes estão construindo IA generativa e LLMs de última geração em escala, graças a nossas milhares GPUs H100 em redes InfiniBand rápidas e de baixa latência”, diz Brian Venturo, cofundador e CTO da CoreWeave. “Nossa submissão MLPerf conjunta com a NVIDIA demonstra claramente o excelente desempenho que nossos clientes desfrutam.”

Desempenho superior disponível

A Inflection AI aproveitou esse desempenho para construir o LLM avançado por trás de sua primeira IA pessoal, Pi, que significa inteligência pessoal. A empresa atuará como um estúdio de IA criando IAs pessoais com as quais os usuários poderão interagir de maneira simples e natural.

“Qualquer um pode experimentar o poder de uma IA pessoal com base em nosso grande modelo de linguagem de última geração que foi treinado na poderosa rede de GPUs H100 da CoreWeave”, afirma Mustafa Suleyman, CEO da Inflection AI.

Cofundada no início de 2022 por Mustafa e Karén Simonyan da DeepMind e Reid Hoffman, a Inflection AI visa trabalhar com a CoreWeave para construir um dos maiores clusters de computação do mundo usando GPUs NVIDIA.

As GPUs H100 ofereceram o mais alto desempenho em todos os benchmarks, incluindo grandes modelos de linguagem, recomendações, visão computacional, imagens médicas e reconhecimento de fala. Eles foram os únicos chips a executar todos os oito testes, demonstrando a versatilidade da plataforma NVIDIA AI.

Excelência em execução em escala

O treinamento geralmente é um trabalho executado em escala por muitas GPUs trabalhando em conjunto. Em cada teste MLPerf, as GPUs H100 estabelecem novos recordes de desempenho em escala para treinamento de IA.

As otimizações em todo o conjunto completo de tecnologias permitiram o dimensionamento de desempenho quase linear no exigente teste LLM, à medida que os envios foram escalados de centenas para milhares de GPUs H100.